出品/未来科技界

作者/李彦

编辑/木鱼

大模型的底层架构,过时了?

过去几年,行业对“Scaling”的理解几乎等同于算力堆砌与参数扩张。但在今年的技术交流中,一个更清晰的共识正在形成:单纯依赖资源线性投入,已经难以持续推高模型能力的上限。如何在效率、结构与系统协同中寻找新的“规模红利”,成为新的命题。

北京时间3月18日凌晨,月之暗面创始人杨植麟在英伟达 GTC 2026大会上首次系统披露了Kimi K2.5的技术路线图,其核心指向“更有效率的规模化”。

他将Kimi的演进总结为三个维度的协同:Token效率、长上下文能力,以及智能体集群(Agent Swarms)。这三个方向并非独立优化,而是试图形成乘数效应——即通过效率提升降低计算成本,通过长上下文提升推理能力,再通过多智能体协作放大任务处理能力,从而整体抬升模型智能水平。

这一技术路线的落脚点,在于对既有基础架构的重构。

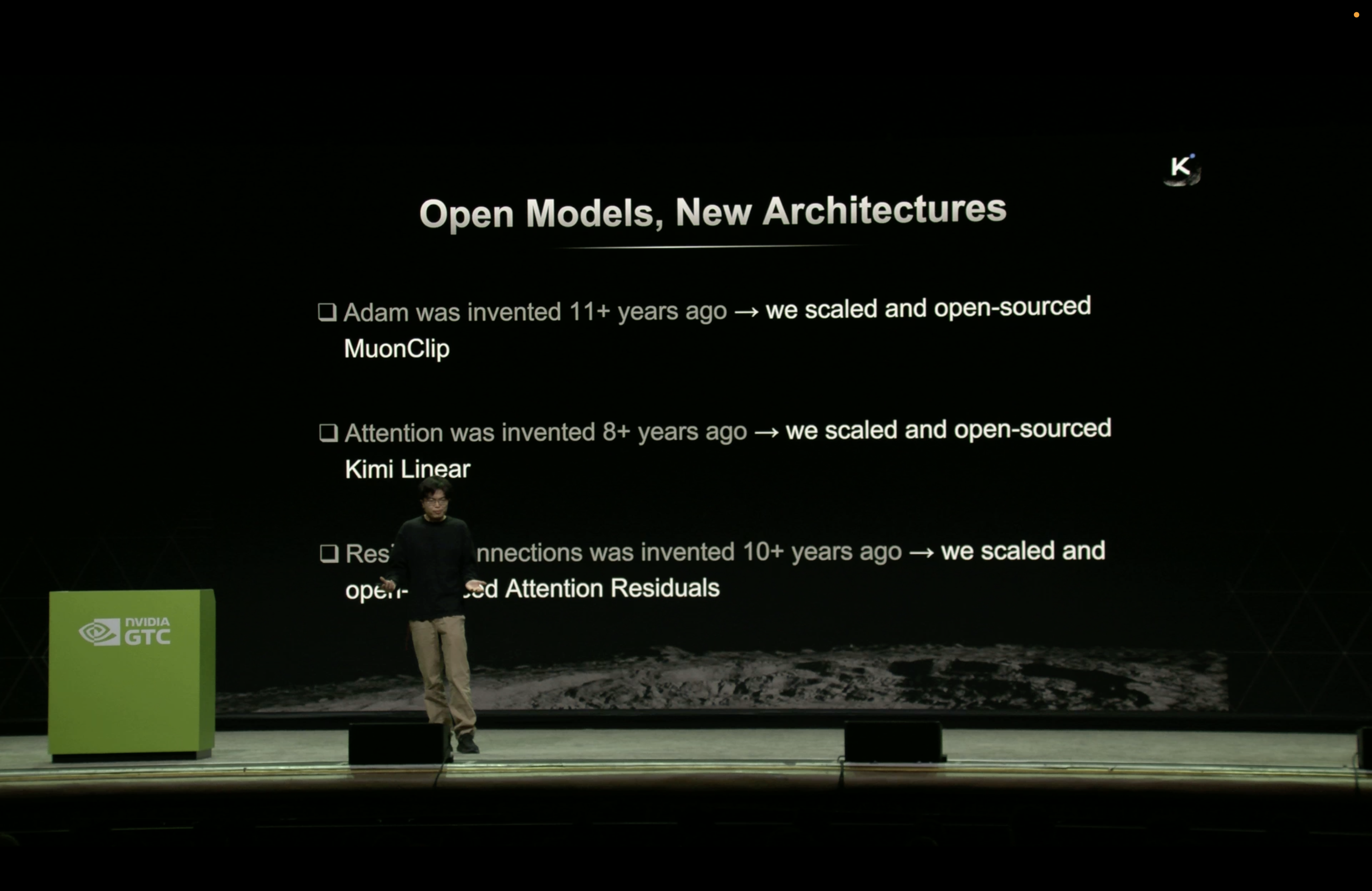

以优化器为例,自2014年以来,Adam系列几乎成为行业标准。但在超大规模训练中,其Tokenl效率与稳定性问题逐渐暴露。Kimi团队在实践中引入Muon优化器,并进一步开发出MuonClip机制,通过数值稳定性改进解决Logits爆炸问题,在效率上实现对AdamW约2倍的提升。这意味着,在相同算力条件下,模型可以完成更多有效训练,从源头提升“性价比”。

针对 2017 年诞生的全注意力机制(Full Attention),杨植麟展示了基于KDA架构的 Kimi Linear。这是一种混合线性注意力架构,它挑战了“所有层必须使用全注意力”的惯例,通过优化递归存储管理,在128K甚至1M的超长上下文中,将解码速度提升了5到6倍,且在不同长度的场景下均保持了优异性能。

与此同时,针对残差连接这一长期被忽视的基础组件,Kimi提出了Attention Residuals方案。通过用注意力机制替代传统的逐层累加,模型可以更有选择性地利用历史信息,从而避免深层网络中信息被稀释的问题。这类改进虽然不如新模型架构“显眼”,却直接作用于模型表达能力的上限。

如果说上述优化仍停留在单模型层面,那么Kimi更进一步的探索,则指向“多模型协作”。

在演讲中,杨植麟提出,未来的AI形态将不再是单一智能体,而是由多个Agent动态组成的协作系统。Kimi K2.5中的Orchestrator机制,能够将复杂任务拆解为多个子任务,并分配给不同Agent并行执行。同时,通过专门设计的强化学习奖励函数,避免多Agent系统退化为串行流程,从而真正实现并行效率提升。

这一思路,实质上将“Scaling”从单模型扩展为“系统级Scaling”。当任务复杂度不断提高,仅依赖单一模型能力已难以覆盖全部场景,分布式智能体协作可能成为新的主流范式。

此外,Kimi在跨模态方向上的实验也提供了一个值得注意的信号:视觉强化学习不仅提升视觉能力,还能够反向增强文本推理能力。在相关基准测试中,这种训练方式带来了约2.1%的文本性能提升。这表明,不同模态之间的能力并非孤立,而是存在可以被利用的迁移关系。

从更宏观的角度看,这场演讲所传递的信息,或许比具体技术细节更重要。

一方面,大模型的发展正在从“资源驱动”转向“效率驱动”。当算力供给逐渐成为瓶颈,谁能在单位算力中挖掘出更高价值,谁就拥有更强的竞争力。

另一方面,AI的竞争边界也在外扩。从模型本身,到训练方法,再到多智能体系统,技术演进正在向更复杂的系统工程演化。

杨植麟在最后提到,过去受限于算力,很多技术想法难以通过大规模实验验证,而现在,随着“Scaling Ladder”的建立,研究者可以在不同规模上反复验证假设,从而让那些曾被忽视的“旧技术”重新焕发生命力。

24小时热榜

24小时热榜

热门视频

热门视频